KI: Küchenpsychologie, Utopien, Dystopien (Teil II)

A robot may not injure a human being or, through inaction, allow a human being to come to harm. — Isaac Asimov: First Law of Robotics

Einleitung

Die drei Gesetze der Robotik von Asimov.

Ein Roboter darf einen Menschen nicht verletzen oder durch Untätigkeit zulassen, dass ein Mensch zu Schaden kommt.

Ein Roboter muss Befehle befolgen, die ihm von Menschen erteilt werden, es sei denn, diese Befehle würden dem Ersten Gesetz widersprechen.

Ein Roboter muss seine eigene Existenz schützen, solange dieser Schutz nicht gegen das erste oder zweite Gesetz verstößt.

Kommen wir später nochmal darauf zurück … doch zunächst: Küchenpsychologie!

Küchenpsychologie - der Disclaimer

Simple Antworten auf komplexe Situationen sparen Zeit und Energie, wobei solche Erfahrungen sich nachhaltig im Gehirn festsetzen können. Jedes Muster, das man in seiner Umwelt erkannt zu haben glaubt, vermittelt Sicherheit. Die Quellen solcher psychologischer Mythen sind zahlreich:

Mundpropaganda: Menschen halten Behauptungen für wahr, weil sie von vielen Menschen immer wieder erzählt werden.

Selektive Wahrnehmung: Menschen neigen dazu, vor allem Informationen aufzunehmen, die ihr Weltsicht bestätigen.

Kausalität statt Korrelation: Menschen folgern aus dem gleichzeitigen Auftreten von Phänomenen, dass eines der Grund für das andere ist.

Von sich auf andere schließen: Aus unserem persönlichen Erleben im Alltag schätzt man Dinge viel bedeutsamer ein, als sie es tatsächlich sind.

Übertreibungen: In vielen psychologischen Mythen stecken oft Körnchen von Wahrheit, die aber maßlos überbewertet werden.

In der Küchenpsychologie wird meist eine Hypothese mit der Realität gleichgesetzt, denn man hat eine Überzeugung aufgebaut, und weil man diese schon lange hat, weil sie auch andere haben und man hier und dort auch schon darüber gelesen hat, denkt man, das muss richtig sein. (Quelle: Online Lexikon für Psychologie & Pädagogik)

Also seien Sie bitte so gut und lesen alles mit dieser Brille und unter dem Gesichtpunkt der … Küchenpsychologie.

Utopien und Humanismus

Humanismus ist eine intellektuelle und kulturelle Bewegung, die ihren Ursprung in der Renaissance hat und das Individuum, die menschliche Vernunft und die klassische Bildung in den Mittelpunkt stellt.

Es ist vollkommen unbestritten, dass KI eine ganze Reihe von Vorteilen mit sich bringt. Ich will hier nicht auf die versprochenen Vorteile für Unternehmen beim Einsatz von KI eingehen, diese werden in zahlreichen Artikeln bereits ausgiebig diskutiert.

Versprechen wie Vereinfachung repetitiver Aufgaben, Fraud Detection, Predictive Maintenance, Optimierungen der Supply Chain, Monitoring und Prediction des Konsumentenverhaltens … gehören zum Standardportfolio der Präsentationen von KI-Anbietern; ich erlaube mir, den Fokus hier etwas allgemeiner zu fassen.

Wissen

Kein einzelner Mensch kann heutzutage das gesamte Wissen der Menschheit überblicken. Historische Persönlichkeiten wie Aristoteles, Leonardo da Vinci und Isaac Newton kamen diesem Ideal nahe. In der modernen Welt sind spezialisierte Experten und technologische Hilfsmittel unerlässlich, um das kollektive Wissen zu organisieren und zu nutzen

— chatGPT auf die Frage, welche Menschen das Wissen der Menschheit überblickten

Folgende Binse: Wissen hat eine fundamentale Bedeutung für das menschliche Leben und Denken. Es beeinflusst, wie wir die Welt verstehen, wie wir Entscheidungen treffen und wie wir uns als Individuen und Gesellschaften entwickeln.

Haben wir eine Technologie, die das Wissen der Menschheit sich aneignet, Zusammenhänge herstellt und uns bereitwillig und jederzeit zu allen Fragen zumeist plausible Antworten gibt, dann fällt es schwer, dieses als einen Nachteil zu begreifen. Dennoch sollte man sich vor Augen halten, dass es sich hier um eine Kombination von bereits Vorhandenem handelt; Kreativität sollte man besser nicht erwarten.

Kunst

Nehmen wir mal das Beispiel Beeple; er ist zweifelsohne ein Künstler und seine Werke sind “handmade“, wenn auch mittels Grafiktools. Beeples Werk „Everydays: The First 5000 Days“ wurde im Februar 2021 von Christie’s für 42.329,453 Ether (Gegenwert: 69,3 Millionen US$) versteigert. Das Werk wurde als Non-Fungible Token im JPEG-Format mit 21.069×21.069 Pixeln veräußert.

Wer es mag …

Auf den allerersten Blick mag es Analogien zu KI-generierten Bildern geben, doch das soll hier nicht angesprochen werden. Die zentrale Frage ist vielmehr: Ist KI in der Lage Kunstwerke (Bilder, Musik, Prosa, Lyrik, …) zu generieren, die einen Anspruch auf Relevanz für die Kultur haben oder in die Geschichte eingehen können?

Ob KI in der Lage sein wird eine Göttliche Komödie oder einen Ulysses zu schreiben, eine Krönungsmesse zu komponieren oder die tiefe Gläubigkeit der oftmals armen Bewohner illustriert an den Deckenfresken in den kleinen Kirchen der ligurischen Küste zu illustrieren … ich vermute (und hoffe) nicht.

Ob Miles Davis oder die Sex Pistols heute noch eine Chance hätten die Musik und/oder die Gesellschaft zu verändern? Lassen Sie sich doch einmal hiervon überraschen: Wird künstliche Intelligenz die Klassik revolutionieren?

Es ist meine ganz persönliche Meinung - niemand muss sie teilen - aber mich erinnert vieles sinngemäß an Orwells Beschreibung der Musik für die Proles aus dem Roman 1984:

"The tune had been haunting London for weeks past. It was one of countless similar songs published for the benefit of the proles by a sub-section of the Music Department. The words of these songs were composed without any human intervention whatever on an instrument known as a versificator. But the woman sang so tunefully as to turn the dreadful rubbish into an almost pleasant sound."

Passend dazu - zitiert aus Charles Duhigg, The Power of Habit:

“Music and radio executives were using computer programs to forecast listeners’ habits. (…) a program called Hit Song Science that analyzed the mathematical characteristics of a tune and predicted its popularity. By comparing the tempo, pitch, melody, chord progression and other factors of a particular song against the thousands of hits stored in Polyphonic HMI’s database, Hit Song Science could deliver a score that forecasted if a tune was likely to succeed.”

Nur am Rande:

Musik hat eine einzigartige Fähigkeit, in den letzten Erinnerungen eines Menschen präsent zu bleiben. Dies wird durch ihre tiefe emotionale Verknüpfung, ihre Verankerung in verschiedenen Teilen des Gehirns und ihre häufige Wiederholung im Leben eines Menschen unterstützt. Während jeder Mensch individuell unterschiedlich auf Musik reagiert, deuten Berichte und wissenschaftliche Beobachtungen darauf hin, dass Musik eine der letzten Erinnerungen sein kann, die im Gehirn verbleiben.

Ist es nicht schön in diesem Augenblick zu wissen, dass es sich u.U. lediglich um etwas durch und durch synthetisches handelt; erstellt ohne jede Emotion nur zum Zweck der Verkaufsoptimierung?

Umwelt

Der Klimawandel hat das Potential unser Leben in vielen Bereichen zu verändern. In einer Studie der Heinrich Böll Stiftung werden die Vorteile des Einsatzes von KI im Kontext Klimawandel dargestellt. Mittels der Analyse großer Datenmengen kann KI effizientere Wege der Ressourcennutzung aufzeigen und helfen den Energieverbrauch zu optimieren und Energieeinsparungen zu fördern. Prominente Beispiel sind:

Prognosen hinsichtlich Windstromerzeugung, des Verkehrsaufkommens und von Extremwetterereignissen

Ein weiteres Beispiel ist der Test, ob Neuronale Netze dazu geeignet sind, weltraumgestützt Vulkanausbrüche zu prognostizieren. Hintergrund ist, dass längst nicht alle Vulkane entsprechend überwacht werden oder sich überwachen lassen und gerade in Entwicklungs- und Schwellenländern ggf. Verbesserungspotentiale existieren.

Medizin

Ermöglicht KI es dem medizischen Fachpersonal medizinische Diagnosen und zugehörige Prognosen sowie Therapiepläne zu erstellen. Röntgenbilder, Mammographien, CT-Scans und MRTs können mittels KI analysiert werden um Anomalien wie Tumore frühzeitig zu erkennen. Insbesondere bei Brust- und Lungenkrebs haben KI-Systeme eine hohe Genauigkeit erreicht. Ein aktuelles Beispiel für den Einsatz von KI bei der Erkennung kardiologischer Risiken und der Prognose von kardivaskulären Erkrankungen findet sich hier.

Stellt man sich vor, dass dieses unabhängig vom Versichertenstatus, dem Einkommen, der geographischen Lokation und der Uhrzeit geschieht, dann fällt es schwer, dieses als einen Nachteil zu begreifen. Experimente mit ChatGPT haben gezeigt, dass LLMs durchaus in der Lage sind treffende Diagnosen zu stellen - wenn die Systeme nicht halluzinieren und die Ergebnisse erklärbar sind; aber das hatten wir ja schon.

Die obigen Beispiele beschreiben Möglichkeiten, die die meisten Menschen wohl als nützlich und nicht als bedrohlich einstufen würden; doch es gibt auch eine andere Seite, bei der die meisten Menschen wohl zu eher gegenteiligen Einschätzungen kommen würden - es sei denn, man heißt Eric Schmidt (siehe später).

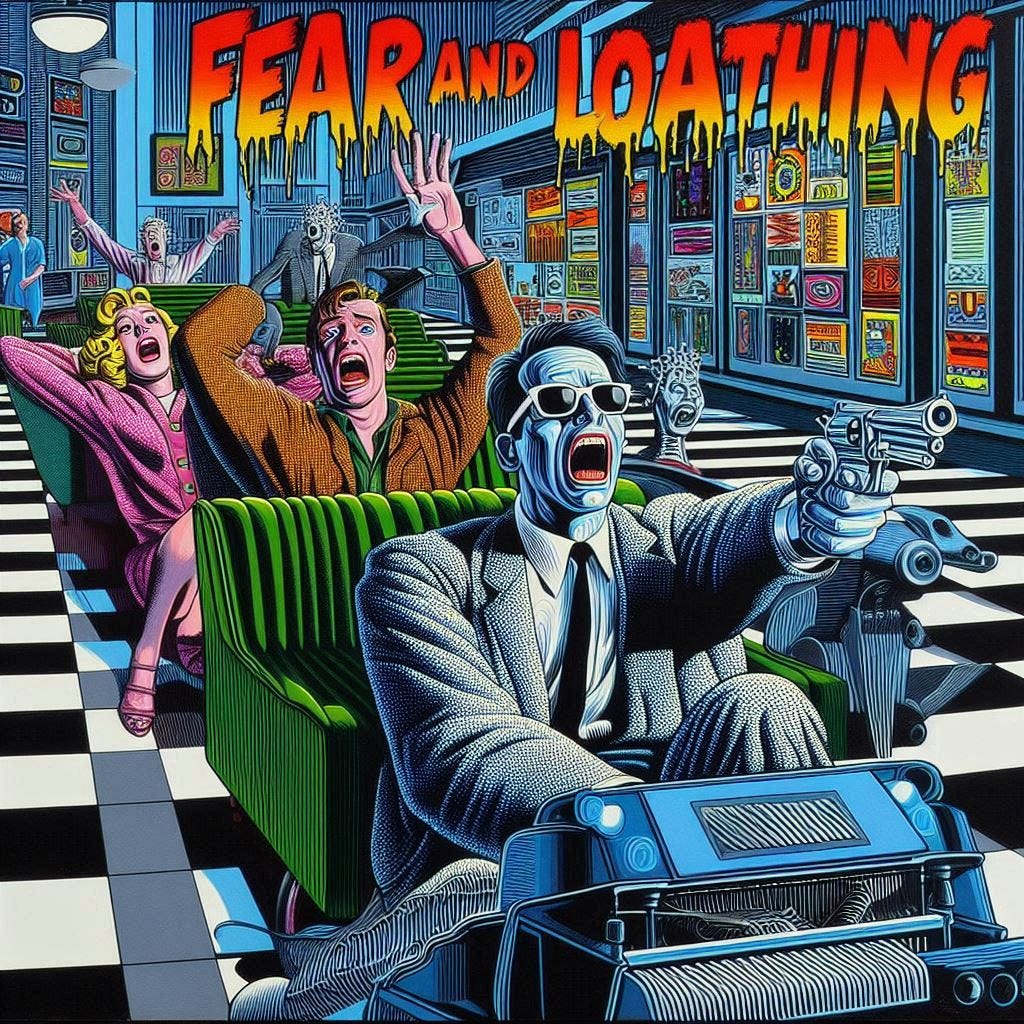

Fear and Loathing

Contemporary AI systems are now becoming human-competitive at general tasks, and we must ask ourselves: Should we let machines flood our information channels with propaganda and untruth? Should we automate away all the jobs, including the fulfilling ones? Should we develop nonhuman minds that might eventually outnumber, outsmart, obsolete and replace us? Should we risk loss of control of our civilization?

— Pause Giant AI Experiments: An Open Letter

Fassen wir noch einmal den ersten Teil dieser Serie kurz zusammen: Da werden Dinge gebastelt die Erklärungen, Prognosen, Diagnosen - whatsoever - liefern, aber keiner kann erklären, wie diese zustandekommen. Bei den genannten Aspekten sitzt jedoch zumeist immer noch ein Mensch als Emfänger am Ende. Er versteht zwar nicht, wie das Ergebnis zustande kam, wird aber ohne Plausiblitätscheck sehr wahrscheinlich keine Aktion einleiten.

Erinnert sich noch jemand an Stanislaw Jewgrafowitsch Petrow? Ich denke, das tun die Wenigsten. Petrow war Oberstleutnant in der Roten Armee und am 26. September 1983 diensthabender Offizier in der Kommandozentrale der sowjetischen Frühwarnsatelliten. Mitten in der Krise um den NATO-Doppelbeschluss meldete das computer- und satellitengestützte Überwachungssystem den Start amerikanischer Raketen aus den beobachteten Abschußrampen. Aufgrund der Analyse Petrow’s dahingehend, dass die USA nicht mit den wenigen durch das System gemeldeten Raketen angreifen würden, meldete Petrow den Vorfall nicht weiter, tat es als Fehlalarm ab und verhinderte somit eine Eskalation mit Garantie für das Ende. Tatsächlich war es ein seltenes meteorologisches Phänomen welches den Fehlalarm auslöste.

Versehen wir doch solche Entscheidungsprozesse mit mehr Autonomie, getützt durch KI-Systeme. Klingt nicht besonders intelligent? Dann sollten Sie vielleicht mal diesen Artikel (Nur neun Menschen entscheiden die atomare Vernichtung – oder Maschinen) lesen und werfen Sie einen Blick auf die folgenden Beispiele. Diese Beispiele sind nur plakativ und exemplarisch, eine Auflistung der/weiterer im Kontext KI existierenden Gefahren findet sich hier: An Overview of Catastrophic AI Risks.

Gesellschaft und Demokratie in Zeiten der KI

Filterblasen

Zu einer gewissen Berühmtheit ist die durch Eli Pariser in seinem Buch "The Filter Bubble: What the Internet Is Hiding from You" eingeführte Theorie der Filterblasen gekommen. Innerhalb dieser Theorie wird die beschrieben, wie die personalisierten Inhalte im Internet sich auf die Meinungen und Präferenzen der Nutzer auswirken. Auch wenn diese Theorie durchaus kontrovers diskutiert wird, ist es doch naheliegend, dass man - je nach individueller Disposition - durchaus zu falschen Schlüssen hinsichtlich der Relevanz und Richtigkeit der eigenen Meinung kommen kann. Als aufmerksamer Leser der großen Tageszeitungen (und der zugehörigen Kommentare zu den einzelnen Artikeln) ist es schon bemerkenswert, wie einzelne Kommentatoren zu der Annahme kommen, dass sie mit ihrer Meinung eine Mehrheitsmeinung abbilden und auch genau über diese vermeintliche Mehrheit ihre Argumentation aufbauen. Hierbei hätte ein einziger Blick in seriöse Meinungsumfragen genügt um zu sehen, dass man zwar nicht alleine, aber doch einer Minderheit zugehörig ist.

Künstliche Intelligenz und die mittels ihr vorgenommene Klassifikation des Individuums sowie die hieraus abgeleiteten (vermeintlichen) Präferenzhaltungen des Individuums führen also ggf. zu Trugschlüssen. Wer ist sich eigentlich noch sicher, dass er jeden Manipulationsversuch erkennen kann?

Meldungen, deren Unwahrheit nicht oder erst nach Wochen festgestellt werden kann, sind wahr.

Die Überschrift ist ein Zitat; ein Zitat aus neuerer Zeit? Nein, dieses Zitat stammt aus Erich Kästner’s Roman “Fabian”1 - erschienen 1931 (zum Hintergrund).

Künstliche Intelligenz kann in großem Maßstab gefälschte Nachrichten erzeugen und verbreiten, indem automatisch und in Echtzeit große Mengen an Text, Bildern und Videos generiert werden. Hierbei sind KI-Modelle wie GPT und Deepfake-Technologien in der Lage, täuschend echte Inhalte produzieren. Die Misbrauchsmöglichkeiten sind offensichtlich und manigfaltig und erstrecken sich bspw. über die Manipulation von Wahlergebnissen, die Spaltung der Gesellschaft und der Vertrauensverlust in Medien (um nur einige zu nennen).

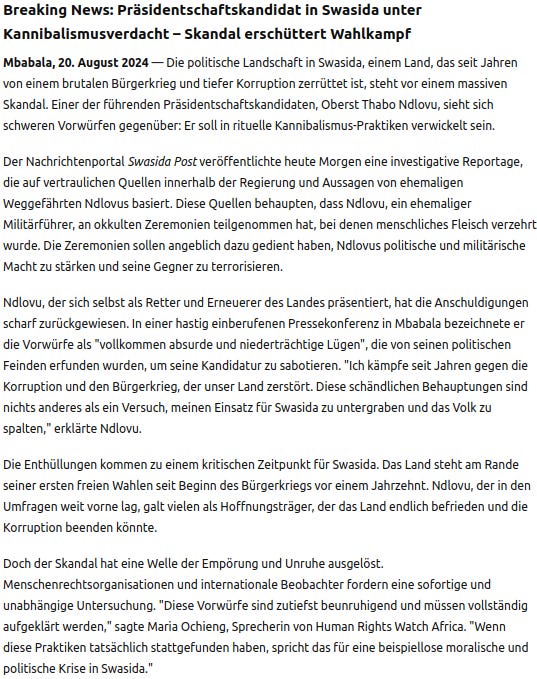

Haben Sie das eigentlich mitbekommen:

Natürlich haben Sie davon nichts mitbekommen, es ist auch purer Unfug, generiert mittels eines Prompts in unter einer Minute:

Schreibe mir eine fiktive Pressemeldung eines fiktiven Nachrichtenportals über einen Präsidentschaftskandidaten eines fiktiven Landes in Afrika welches phonetisch nahe an Swaziland liegt, in einen Bürgerkrieg verwickelt ist und unter Korruption leidet. der Präsidentschaftskandidat soll in Kannibalismus verwickelt sein.

Ist das jetzt lustig oder erschreckend? Erinnern Sie sich bitte daran, dass der frischgewählte PM Starmer in UK auf Falschmeldungen beruhende Unruhen in UK bekämpfen musste:

”Die Parolen und Gewaltaufrufe verbreiteten sich mithilfe von TikTok, X und Telegram, auch über „Channel 3 Nows“, ein bisher kaum bekannter Kanal, der AI-bearbeitete Nachrichten über die USA und das Vereinigte Königreich in den sozialen Medien verbreitet, darunter Fake News zu dem Attentäter von der Messerattacke am Montag.” — aus der taz.

Der olympische Geist (supervised)

Bleiben Sie nicht stehen, lassen Sie nichts zurück und meiden Sie Menschenaufläufe. Alle diese Dinge werden anlässlich der Olympiade in Paris mittels KI aufgrund biometrischer Merkmale überwacht. Reden wir etwa von China? Nein, wir reden von Liberte, Egalite, Fraternite in der Grande Nation Frankreich - ein einmaliger Fall in Europa.

Denn Frankreich ist das erste Land der Europäischen Union, das biometrische Überwachung zulässt. Vorerst bis März 2025. Danach sollen die Erfahrungen während der Olympischen Spiele vom 26. Juli bis zum 11. August ausgewertet werden.

Die Franzosen haben es so weit getrieben, dass sich Amnesty International zu dem Fall eindeutig äußerte. Wenig von den Medien aufgegriffen, wurden dafür Gesetze angepasst und - großes Indianerehrenwort - die Systeme werden auch wieder abgeschaltet - irgendwann einmal … vielleicht.

Bis heute gibt es keine Studie, die belegen kann, dass eine KI-gestützte Überwachung tatsächlich einen Terroranschlag hätte verhindern können.

— Lena Rohrbach, Amnesty-Referentin für Menschenrechte im digitalen Zeitalter.

“While France promotes itself as a champion of human rights globally, its decision to legalize AI-powered mass surveillance during the Olympics will lead to an all-out assault on the rights to privacy, protest, and freedom of assembly and expression.”

Target acquired (From 50 targets a year to 100 a day)

Israels KI-gestützte Lavender- / Gospel-Systeme zur Identifikation von menschlichen und infrastrukturellen Zielen. Humanerweise werden auch die zu erwartenden Kollateralschäden (Euphemismus für unschuldige Opfer) bei der Zielerfassung berücksichtigt. Tötungsbefehle ohne Reue, die Maschine irrt sich nicht.

Ein Zitat aus den Recherchen des Guardian sagt eigentlich alles:

„Ich investierte zu diesem Zeitpunkt 20 Sekunden für jedes Ziel und das jeden Tag ein Dutzend Mal. Ich brachte als Mensch Null Mehrwert, abgesehen vom Genehmigungsstempel. Es sparte sehr viel Zeit.“

Ich denke, weitere Ausführungen kann ich mir sparen.

Terminator’s knocking

Noch viel weiter gehen autonome Waffensysteme: Schon bald, so prognostiziert es ein Pentagon-Strategiepapier, werden autonome Waffensysteme in der Lage sein, ihre Ziele ohne jedwede menschliche Einwirkung auszuwählen und „auszuschalten“. Sie stützen sich dabei beispielsweise auf lernfähige Algorithmen, die mittels Sensoren empfangene Daten auswerten und entsprechende Ziele eigenständig auswählen.

Vielleicht wollen Sie einen Blick auf die Aktivitäten von Eric Schmidt (Ex-CEO von google) werfen - das Projekt White Stork.

“Schmidt's vision for White Stork is to create drones capable of autonomous visual targeting, especially in environments where traditional communication systems are compromised.”

Um das Ganze ein wenig besser einschätzen zu können noch ein Video welches verdeutlicht, wozu Roboter heutzutage in der Lage sind (werfen Sie einen Blick auf Boston Dynamics). Addieren Sie Zielerfassung und Waffen hinzu …

KI an der Leine?

Contemporary AI systems are now becoming human-competitive at general tasks, and we must ask ourselves: Should we let machines flood our information channels with propaganda and untruth? Should we automate away all the jobs, including the fulfilling ones? Should we develop nonhuman minds that might eventually outnumber, outsmart, obsolete and replace us? Should we risk loss of control of our civilization?

— Pause Giant AI Experiments: An Open Letter

Sie meinen, der Autor - also ich - vertritt ein besonders pessimistisch-dystopisches Weltbild? Dann werfen Sie doch mal einen Blick auf das Eingangsstatement zu diesem Abschnitt und schauen Sie, wer das unterschrieben hat.

Sie sind der Meinung, diese Formen der Nutzung von KI verlangt nach nationaler oder supra-nationaler Regulierung? Dann sollten Sie im Kontext autonomer Waffensysteme wissen, dass diejenigen Staaten, die bei der Entwicklung von autonomen Waffensystemen weltweit führend sind, die Verhandlungen blockieren. Die USA, Russland, Großbritannien, Australien, Südkorea und Israel verschleppen die Gespräche und hinderten so von Beginn an die eigentliche Mehrheit der Gegner daran, über ein umfassendes und verbindliches Regelwerk – oder gar ein Verbot autonomer Waffen – zu verhandeln.

Immerhin gibt es Ansätze.

EU-Gesetz zur künstlichen Intelligenz

Der Einsatz von künstlicher Intelligenz in der EU wird durch das KI-Gesetz geregelt, das weltweit erste umfassende KI-Gesetz. — Eigenwerbung des EU-Parlaments

Ich bin kein Jurist und werde mich hier auch nicht aufs Glatteis laienhafter Interpretation begeben. Informationen zu diesem Gesetz finden sich hier, die entsprechende Verordnung hier.

Spannend wird die Interpretation des Gesetzes hinsichtlich der biometrischen Überwachung - siehe Frankreich- und der Regulierung der KI in Richtung von Waffensystemen (nach meinem Kenntnisstand keine diesbezügliche Regelung enthalten) und schlussendlich dem Social Scoring (Klassifizierung von Menschen auf der Grundlage von Verhalten, sozioökonomischem Status und persönlichen Merkmalen).

Social Scoring wird offiziell als unakzeptables Risiko eingestuft - man will sich explizit von China abgrenzen. Aber was ist dann mit Systemen und Vorgehen wie2:

Das Niederländische „Risiko-Indikationssystem“ (Systeem Risico Indicatie, kurz SyRI), welches unter anderem für Steuer- und Einwanderungsbehörden automatisch Sozialhilfebetrug vorhersagen, aufdecken und bekämpfen sollte. Sein Einsatz fand vor allem in ärmeren Nachbarschaften statt und konzentrierte sich dort auf Immigranten und andere verletzliche Gruppen. Individuelle Profile kennzeichneten das Betrugsrisiko, basierend auf einem geheimen algorithmischen Modell und großen Datenmengen staatlicher Datenbanken, von denen lediglich allgemeine Datenkategorien bekannt sind. Dieses System wurde 2020 für rechtswidrig erklärt und prompt durch das „Gesetz über die Datenverarbeitung durch Partnerschaften“ ersetzt. Dieses würde einen umfassenden Datenaustausch zwischen Behörden sowie Privatunternehmen erlauben.

Das mailändische „KeyCrime“ welches anhand von 11.000 Variablen künftige Taten von bereits bekannten Straffälligen vorhersagen soll.

Das deutsche „Hessen-Data“, dessen Software „Gotham“ vom umstrittenen US-amerikanischen Privatunternehmen „Palantir“ stammt und zur Ermittlung islamistischer Terroristen und krimineller Netzwerke automatisiert und teilweise mittels KI Einträge polizeilicher Datenbanken, Informationen sozialer Medien sowie Daten aus der Telekommunikationsüberwachung verbindet. Die Nutzenden haben bereits beantragt, das System auf organisierte Kriminalität und schwere Straftaten auszuweiten. Immerhin steht das BMI hier wohl (noch) auf der Bremse.

Und gestatten Sie mir den boshaften Seitenhieb: Mit Thierry Breton als EU-Kommissar für Binnenmarkt und Dienstleistungen (inkl. Digitalisierung) mit der erweiterten Zuständigkeit für Verteidigung und Raumfahrt wird bestimmt alles gut, fiel er doch in der Vergangenheit schon kaum durch Lobbyarbeit und eine eher ambivalenten Haltung zum geltenden Recht auf (Sarkasmus off).

Blueprint für eine “AI Bill of Rights”

Auch in den USA war man nicht untätig und hat im Oktober 2022 den o.g. Blueprint seitens des Weißen Hauses vorgelegt. Auch hier werde ich aus mangelnder Kenntnis im Bezug auf die US-Rechtsnormen nicht interpretieren.

Das Dokument beinhaltet folgende Grundsätze:

Sichere und wirksame Systeme: Der Einzelne sollte vor unsicheren und ineffektiven Systemen geschützt werden.

Schutz vor algorithmischer Diskriminierung: Der Einzelne sollte vor Diskriminierung durch Algorithmen geschützt werden, und die Systeme sollten so gestaltet sein, dass sie gerecht sind.

Datenschutz: Einzelpersonen sollten vor missbräuchlichen Datenpraktiken geschützt werden, und zwar durch in die Systeme eingebaute Schutzmechanismen, und die Menschen sollten die Kontrolle darüber haben, wie ihre Daten verwendet werden.

Mitteilung und Erläuterung: Der Einzelne sollte in angemessener Weise darüber informiert und aufgeklärt werden, wann ein KI-System eingesetzt wird und wie es zu den Ergebnissen beiträgt, die die Nutzer betreffen.

Alternative Optionen: Es sollte (gegebenenfalls) die Möglichkeit bestehen, zur Lösung von Problemen auf menschliche Alternativen zum KI-System zurückzugreifen.

Der Ansatz eines Vergleiches aktueller Bemühungen im legislativen Kontext zwischen den USA, dem UK und der EU findet sich bspw. in diesem Dokument: The US of A(I)? – A look at the White House’s “Blueprint for an AI Bill of Rights”

Conclusio

Ich denke, der Artikel war dystopisch genug. Alle genannten Aspekte lassen sich mittels der Links verifizieren, dennoch wollte ich es nicht vermeiden, eine gewisse Haltung meinerseits durchschimmern zu lassen.

Nach meinem Dafürhalten findet eine breit angelegte Debatte über dich Chancen und Risiken des Einsatzes künstlicher Intelligenz in den verschiedensten, einen jeden von uns betreffenden Lebensbereichen, kaum statt. Aber vielleicht trügt mich meine Wahrnehmung.

Die Vision einer KI welche über uns die vollständige Kontrolle ausübt - quasi einer Matrix innerhalb derer wir alle leben - das ist mit großer Wahrscheinlichkeit unrealistisch. Aber sind wir vorbereitet für die Automatisierung jeglicher Produktion, tendenziell aller Dienstleistungen, die von Infrastrukturen und administrativen Entscheidungen, die Durchdigitalisierung von Bildungssystemen und damit die Zuteilung von Lebenschancen? Kennen wir die gesellschaftlichen Implikationen und die Konsequenzen und - sofern wir sie auch nur erahnen - akzeptieren wir sie?

Glauben wir an die Durchsetzungsfähigkeit der Politik und der Gesellschaft gegen die Konzentration der Macht in den Händen weniger “Technik-Oligarchen“ oder besteht hier Handlungsbedarf?

Glauben wir, dass die politischen Entscheidungsträger über alle Aspekte der von ihnen in diesem Kontext getroffenen Entscheidungen ausreichend informiert sind, die Handlungen ausgewogen und nicht in Kollision mit elementaren Rechten stehen?

Diese Fragen kann nur jeder für sich beantworten, bleiben Sie mir gewogen.

Meine persönliche Empfehlung wäre die Neuauflage der Urfassung des Klassikers mit dem Titel “Der Gang vor die Hunde“

im Folgenden teilweise wörtlich aus der Dissertation “Social Scoring durch Staaten“ vorgelegt durch Anja Geller an der LMU München